DALL-E3发布之前,全球范围内主流的AI绘画平台主要有Midjourney、Stable Diffusion。Midjourney的特点是上手成本低,简单的提示词就可以画出媲美专业级别的画作。Stable Diffusion的特点是可控性高,通过ControlNet和Lora模型的组合,可以精细控制画的生成。

Midjourney和Stable Diffusion占据AI绘画的生态位的时候,OpenAI的AI绘画还是DALL-E2。DALL-E3生成的画远不如Midjourney和Stable Diffusion。作为人工智能的巨头OpenAI,居然在AI绘画领域落后,有点不像话了。

在Midjourney和Stable Diffusion占据市场主要份额的情况下,Dall-E3发布,可以说是弯道超车了。

DALL-E3的性能虽然比它的前辈DALL-E2升级了好几倍,但是市场分额已经被Midjourney和Stable Diffusion占据,那么DALL-E3有什么优势?凭什么有机会弯道超车呢?

1、背靠大树好乘凉

DALL-E3集成到了ChatGPT,要知道ChatGPT现在是世界上最强的AI平台,其自带的光环不用说都知道有多耀眼。有ChatGPT的光环加持,即便是垃圾,也会有上亿人去体验。

所以,让DALL-E3以一个王者的姿态站在大众面前,就已经从Midjourney和Stable Diffusion的包围圈中突围而出了。

但是,打江山容易,守江山难啊,突围只是成功的第一步,留下才是最终目的。没有好的体验,出场时有多风光,跑路时候就有多狼狈。但是好在DALL-E3的体验,并没有让我们失望。

相对于AI绘画的两个土著,Midjourney和Stable Difussion,DALL-E3也有土著们没有的优势

2、使用方便,提示词简单

DALL-E3的使用门槛非常低!只需要简单的描述,ChatGPT就可以生成提示词,然后生成一幅画。

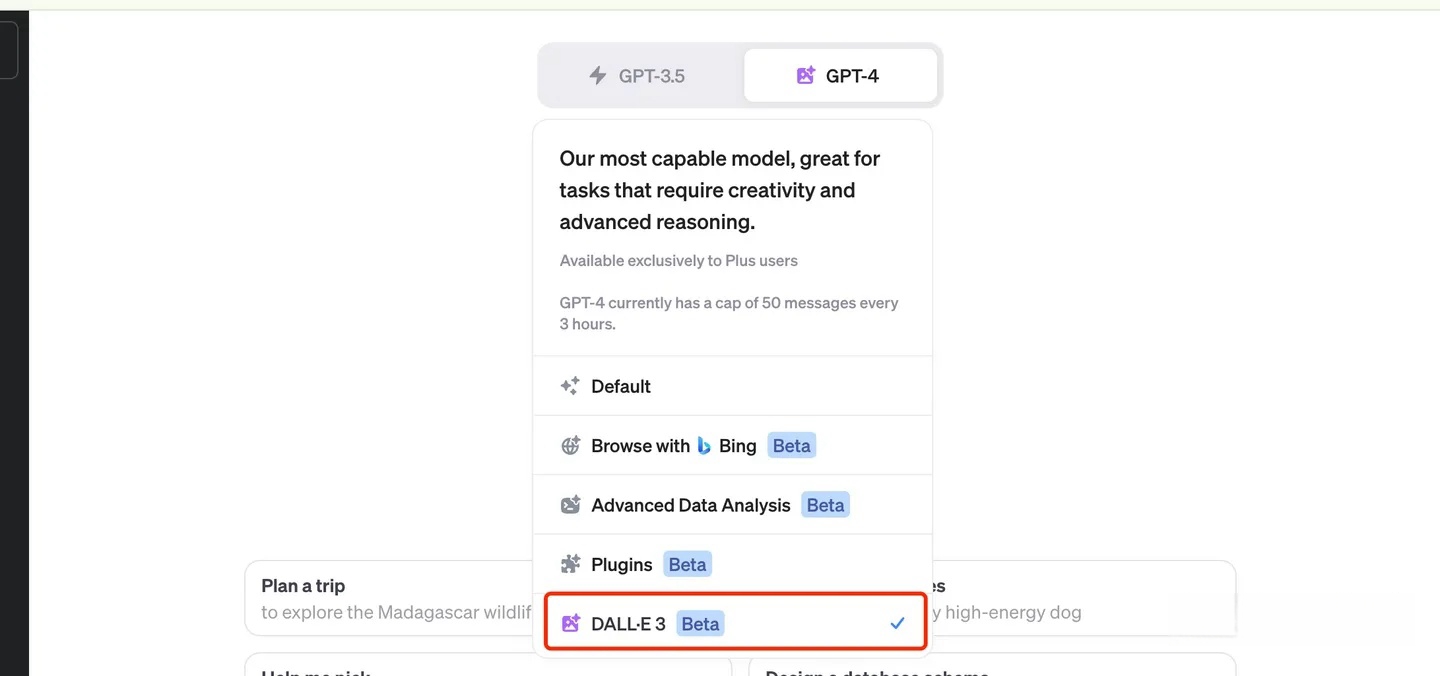

比如,我想生成一只动漫风格可爱的小仓鼠,那么我只需要和ChatGPT说“生成一只动漫风格可爱的小仓鼠”。

两只动漫风格的戏小仓鼠,提示词为“生成一只动漫风格可爱的小仓鼠”

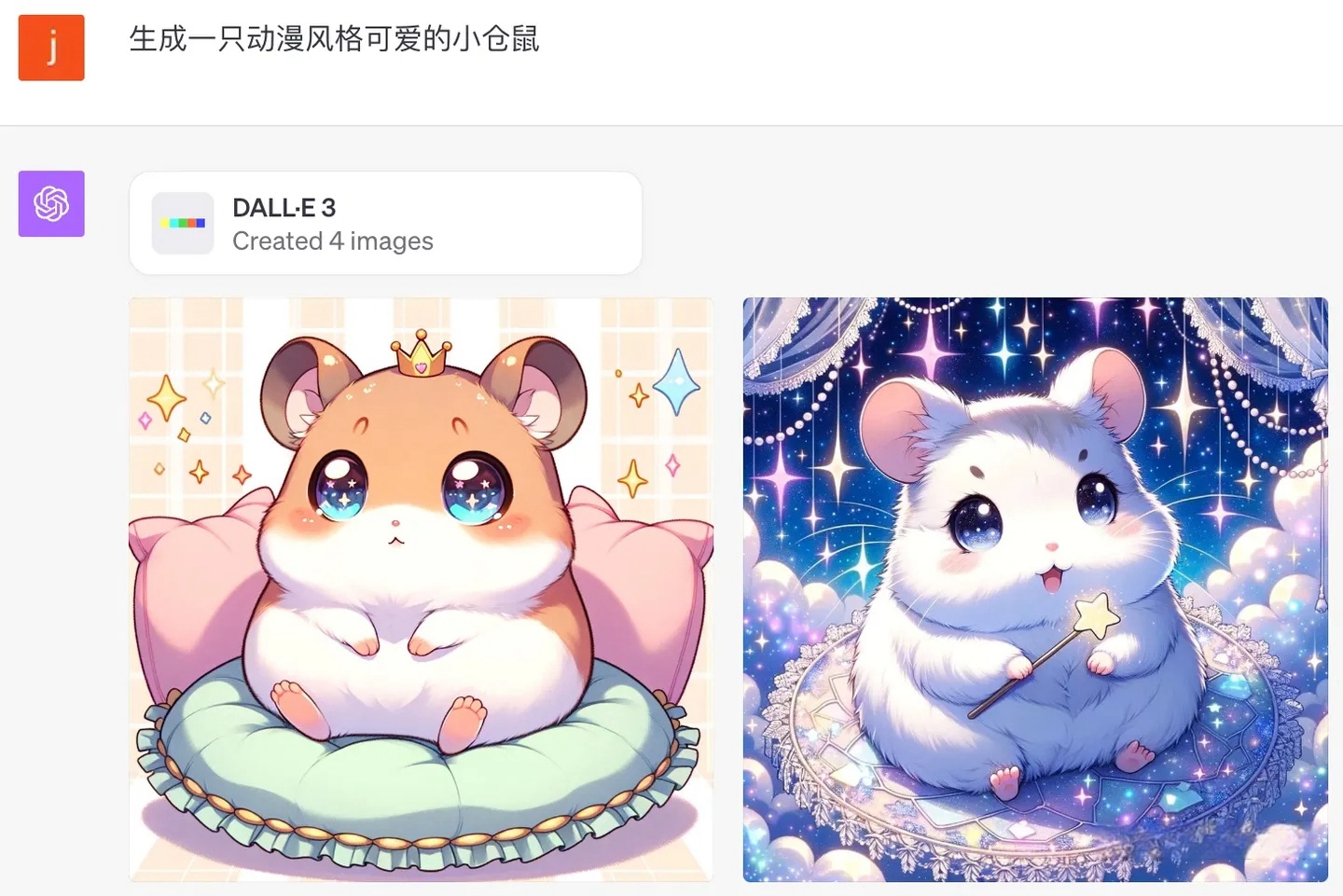

chatgpt自动将提示词补全了

我们的提示词是非常简单的,只是“生成一只可爱的小仓鼠”,ChatGPT就帮我们把提示词丰富了。如果我们用Stable Diffusion或者Midjourney画这样的小仓鼠,需要怎么画呢?

midjourney可能简单一些,直接填上提示词,”a cute hamster, big eyes, cartoon style, sitting on a pastel-colored…”等等,一长串的提示词

Stable Diffusion就更麻烦了,首先,你需要到C站找到对应的模型,然后设置一长串正向提示词,再设置一长串反向提示词。。。

这么一对比,是不是觉得DALL-E3特别简单?

3、精确的提示词理解能力

最让我惊喜的还是提示词的理解能力,我在写文章的时候,想通过一只小仓鼠加强我的情感表达。

比如说,我看到一些不好的东西时,想表达我愤怒的感情,这时候就需要用到一只有愤怒表情的小仓鼠图片。

有时想用表达自己欣喜若狂的感觉,那么就要找一只欢呼雀跃的小仓鼠的图片。

用Midjourney或者Stable Diffusion画这种有细致感情的图片,不是说不可以。但是用这两个工具需要花费很长的时间,而且效果不一定要,需要多次抽卡。DALL-E3就不一样了,它能够很好理解我提示词的意图,我花了很多这样的图,几乎是一次性搞定。

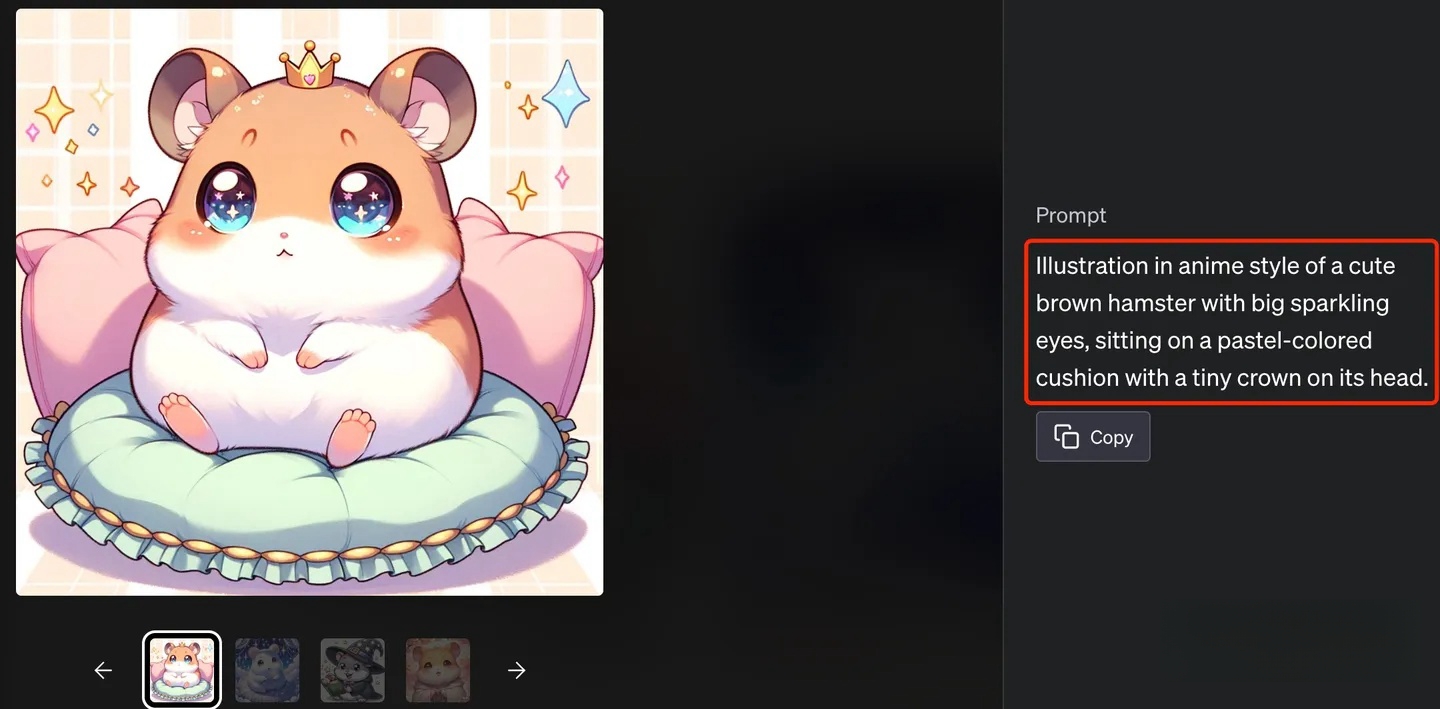

来给大家演示下,比如说,我想画一个“愤怒的小仓鼠”,那么我提示词是“生成一只愤怒的,可爱的小仓鼠,卡通风格,横图”

愤怒的小仓鼠

可以看到,DALL-E3给了我4幅图,第一幅我觉得就挺好,愤怒的情绪表现的很形象。

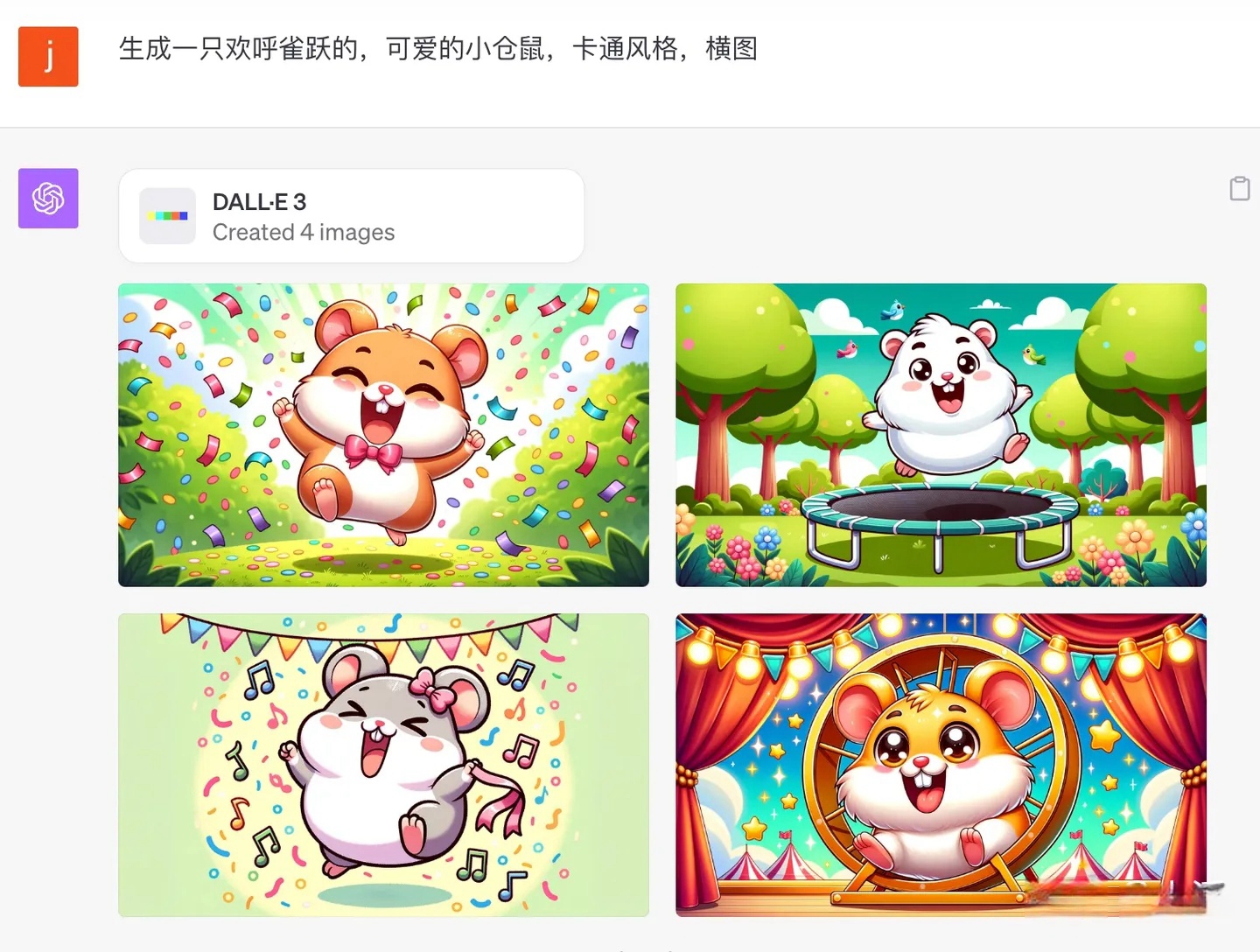

再来看看另外的提示词效果,我想画一个“欢呼雀跃的可爱的小仓鼠”,那么我的提示词是“生成一只欢呼雀跃的,可爱的小仓鼠,卡通风格,横图”

欢呼雀跃的小仓鼠

返回的4图画中,第一幅我觉得挺不错的。我们添加一些场景描述,让提示词看起来更复杂一些,看看DALL-E3能不能生成满足我们的画。

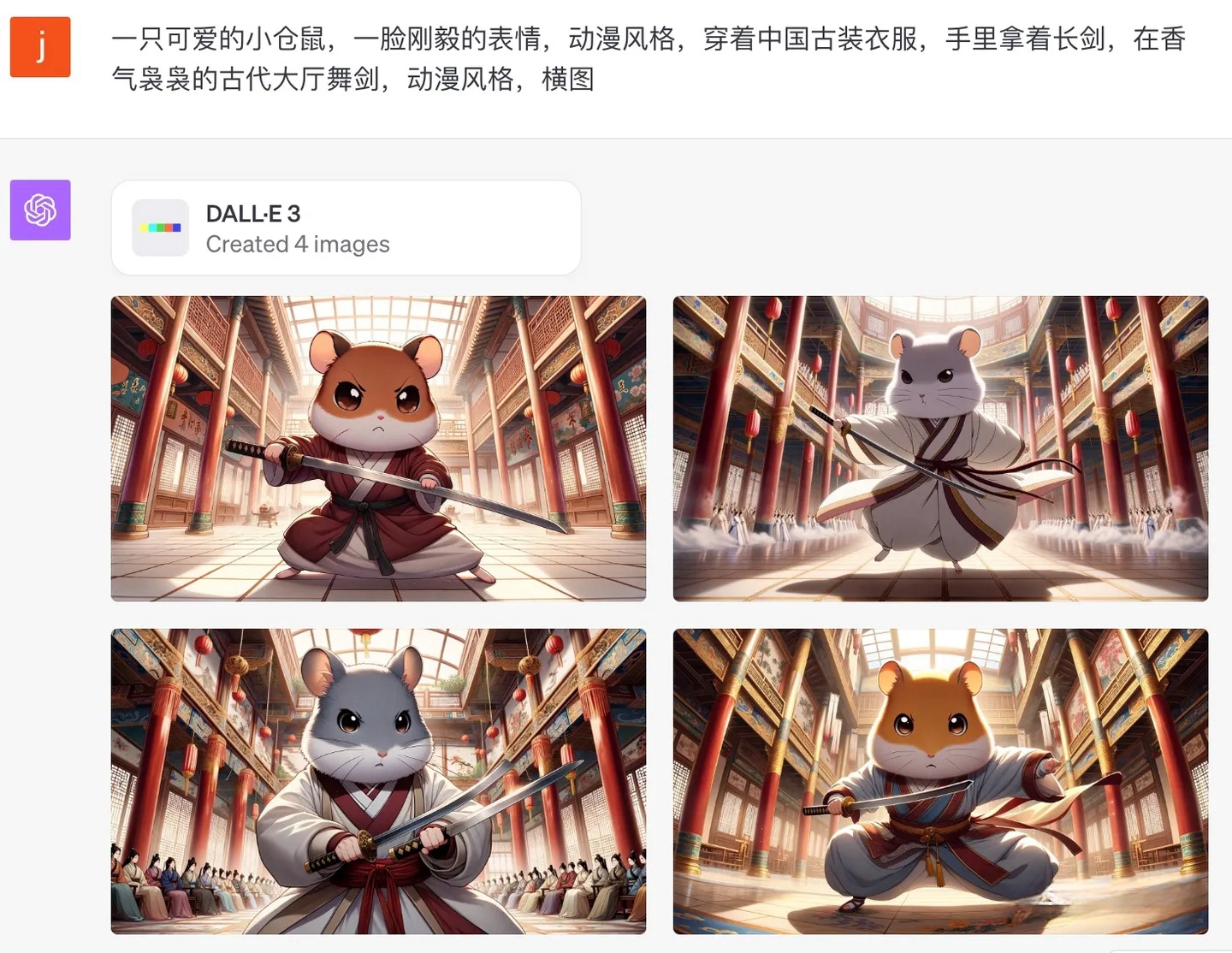

“一只可爱的小仓鼠,一脸刚毅的表情,动漫风格,穿着中国古装衣服,手里拿着长剑,在香气袅袅的古代大厅舞剑,动漫风格,横图“

剑客小仓鼠

从返回的画看起来,我们要求的场景、表情、动作基本上一致,用来做文章的配图真的爽歪歪。

4、丰富的知识库

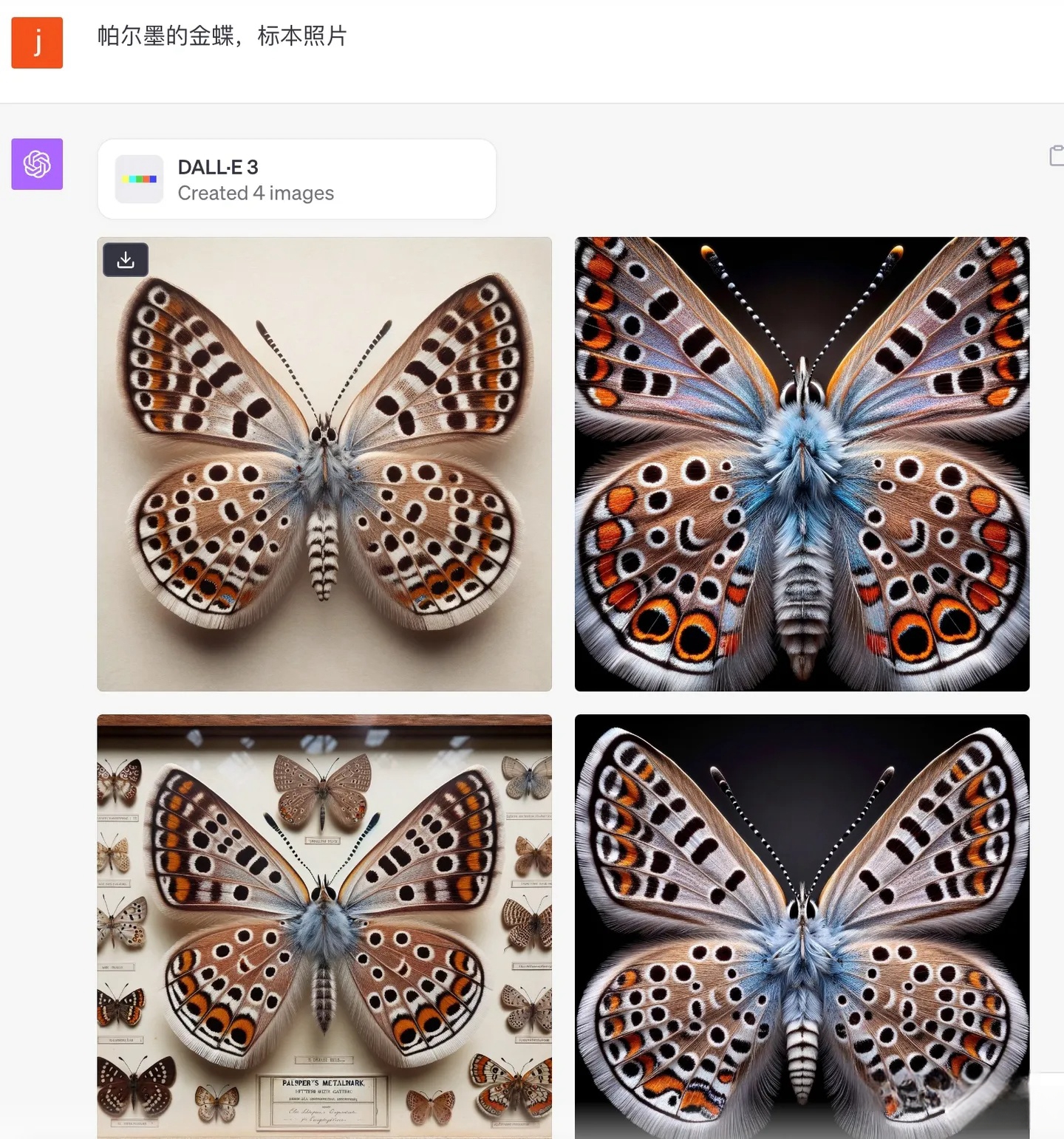

假设你是个蝴蝶研究专家,你在写篇关于蝴蝶的文章,想找张某种私有品类的蝴蝶标本用作范例。

如果是以前的话,你可能需要去百度疯狂的搜索,但有时候,找到的图片不一定是满意的。用DALL-E3就简单啦,直接让他画一张就行。

比如,我们先让ChatGPT说说这个世界上最稀有的蝴蝶是什么。

在得到ChatGPT的回答后,我们知道最稀有的蝴蝶之一是“帕尔墨的金蝶”。不一定对,大模型幻觉问题现在也没有解决,所以我们要自己有辨别能力。

然后我们再让ChatGPT帮我们画一幅“帕尔墨的金蝶”的标本照片。

不到几分钟就画出来了。不会ChatGPT的人可能还在满头大汗找配图,还得考虑版权问题,会ChatGPT的人,一分钟就画出来了,这就是AI的魅力。

5、DALL-E3 VS Midjourney VS Stable Diffusion

DALL-E3厉害吗?

确实很厉害,能够精确理解提示词,有丰富的知识库。

DALL-E3比Midjourney和Stable Diffusion都强吗?

并不见得,从画质上看,DALL-E3并不逊色于两种AI绘画工具。

但是,因为涉及到版权问题,DALL-E3并不能模仿一些艺术家的风格的画,Midjourney却可以。

另外DALL-E3能通过提示词画图,但是,不能够提供精细化的控制图像生成,比如动作。Stable Diffusion却可以。

即便存在诸多比不上Midjourney和Stable Diffusion的地方。

但是,DALL-E3的便捷性,丰富的知识库,准确的提示词理解能力,可以让我们快速生成PPT的插图、文章插图,DALL-E3必然有能力保留自己的市场地位。

DALL-E3还是非常有潜力的,在未来,DALL-E3也许会提供垫图、更精细化的控制能力,那么将又是一个杀手锏。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

终身版AI工具